Cuộc chạy đua về trí tuệ nhân tạo (AI) ngày càng nguy hiểm, có thể gây ra những hậu quả khó lường và đe dọa vận mệnh của nhân loại, là lý do các giám đốc điều hành, chuyên gia AI hàng đầu kêu gọi “đạp thắng” trong việc phát triển công nghệ này.

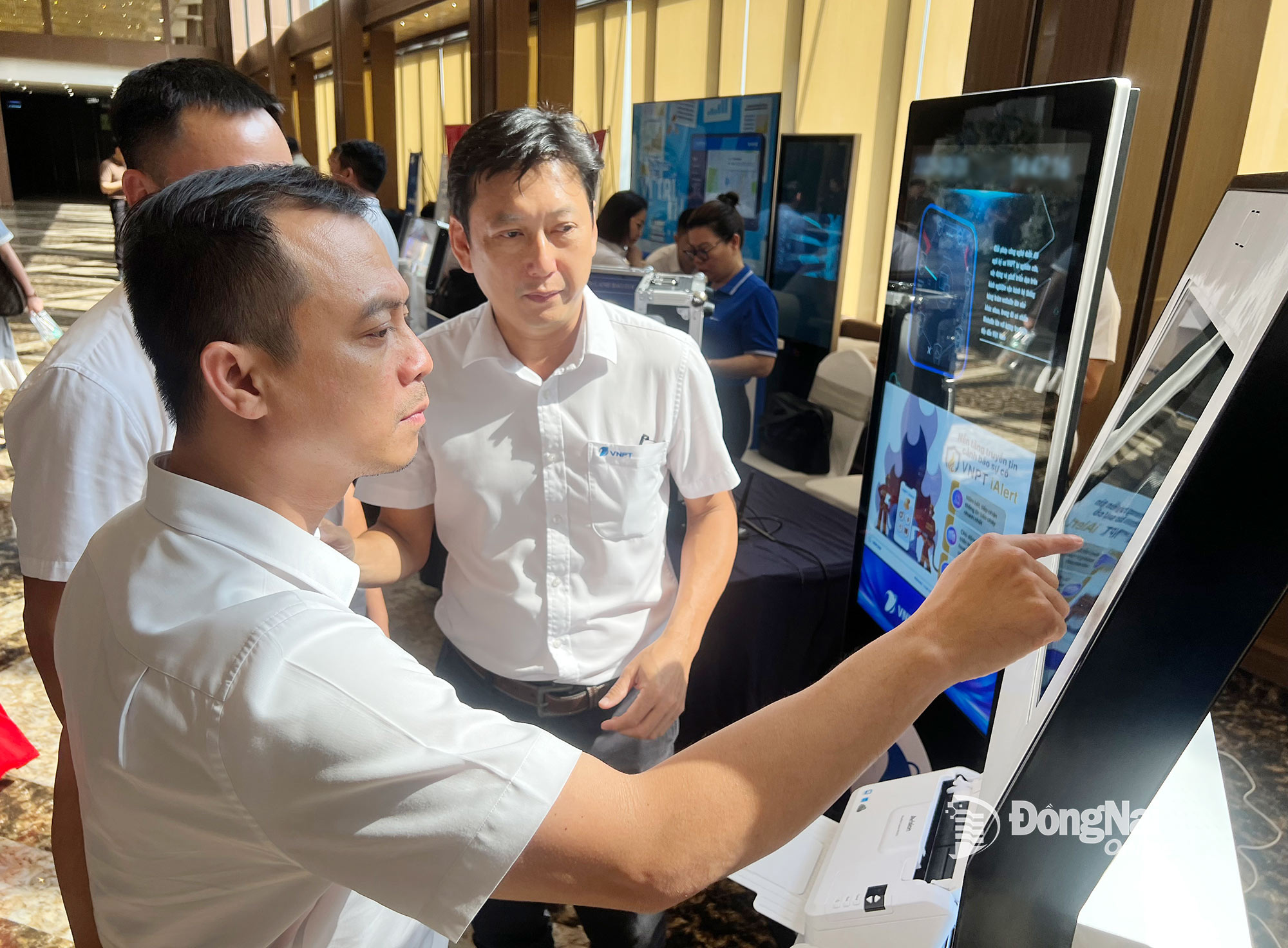

Một siêu máy tính trí tuệ nhân tạo (AI) đặt tại California, Mỹ

Mới đây tỉ phú Mỹ Elon Musk, nhà đồng sáng lập Apple Steve Wozniak, nhà tiên phong về trí tuệ nhân tạo Yoshua Bengio, các chuyên gia từ Amazon, Google, DeepMind, Meta, Microsoft… đã cùng ký vào thư kêu gọi tạm ngừng đẩy mạnh phát triển AI để thiết lập các tiêu chuẩn an toàn và ngăn chặn nguy cơ tiềm ẩn từ công nghệ này.

Lá thư là sáng kiến từ Future of Life Institute (Viện Tương lai sự sống), hiện đã có chữ ký của hơn 1.000 người.

Cuộc đua tự sát

Những người tham gia không kêu gọi hoàn toàn chấm dứt phát triển AI, thay vào đó cho rằng các công ty nên tạm thời dừng các hệ thống học máy mạnh hơn GPT-4, công nghệ được Công ty khởi nghiệp OpenAI do Microsoft đứng sau tung ra trong tháng 3-2023.

“Những tháng gần đây, các phòng thí nghiệm AI đã bị cuốn vào một cuộc chạy đua ngoài tầm kiểm soát nhằm phát triển và triển khai những trí tuệ kỹ thuật số mạnh mẽ hơn bao giờ hết mà không ai, kể cả những người tạo ra chúng, có thể hiểu, dự đoán hoặc chắc chắn kiểm soát được”, bức thư viết.

Kể từ khi OpenAI ra mắt Chat GPT vào cuối năm ngoái, Google cũng tham gia cuộc cạnh tranh và hàng loạt công ty như Adobe, Zoom, Salesforce trình làng các công cụ AI mới.

Nhưng sức nóng của AI làm dấy lên những lo ngại mới rằng việc triển khai nhanh chóng công nghệ này có thể gây ra những hậu quả không lường trước được bên cạnh những lợi ích thực sự. Max Tegmark, chủ tịch Future of Life Institute và là giáo sư vật lý tại Viện Công nghệ Massachusetts, cho biết những tiến bộ trong lĩnh vực AI đã vượt qua những gì mà nhiều chuyên gia dự báo vài năm trước.

“Thật đáng tiếc khi coi đây (sự phát triển AI) như một cuộc chạy đua vũ trang. Nó giống một cuộc đua tự sát hơn. Không quan trọng ai sẽ về đó trước. Nó chỉ có nghĩa là toàn nhân loại có thể mất quyền kiểm soát vận mệnh của chính mình”, ông Tegmark nói.

Các lãnh đạo và chuyên gia cho rằng cần có thời gian để nhìn rõ và chuẩn bị cho sự phát triển AI một cách đúng đắn

Khoảng nghỉ

“Chúng ta đã đạt đến điểm mà các hệ thống này đủ thông minh để có thể sử dụng chúng theo những cách gây nguy hiểm cho xã hội. Và chúng ta vẫn chưa hiểu hết về điều đó”, tờ Wall Street Journal dẫn lời ông Bengio – giám đốc Viện Thuật toán học tập Montreal thuộc Đại học Montreal, Canada – cho biết trong một cuộc phỏng vấn gần đây.

Thời gian qua, các chuyên gia AI ngày càng lo ngại về khả năng các công cụ AI phản ứng sai lệch, lan truyền thông tin sai và ảnh hưởng đến quyền riêng tư của người dùng. Những công cụ này cũng đặt ra những tranh cãi xung quanh việc liệu AI có thể thay thế con người trong một số lĩnh vực, giúp sinh viên gian lận và thay đổi mối quan hệ của con người với công nghệ.

Ông Tegmark cho biết nhiều công ty chịu “áp lực thương mại điên cuồng” để thêm công nghệ AI vào sản phẩm của mình. Việc tạm dừng 6 tháng sẽ cho phép họ “có không gian thở” mà có lựa chọn cẩn thận. Theo bức thư, các phòng phát triển AI và các chuyên gia có thể sử dụng thời gian này để phát triển một bộ quy tắc an toàn chung cho thiết kế AI.

Ông Emad Mostaque, giám đốc điều hành của Stability AI, nói rằng dù bức thư không có sự ràng buộc nhưng sẽ khởi động một cuộc thảo luận quan trọng nhằm mang lại “sự minh bạch và quản lý tốt hơn cho một lĩnh vực còn mơ hồ”.

Bill Gates không đồng ý

Tỉ phú Bill Gates, nhà sáng lập Microsoft, không tham gia ký bức thư nói trên. Trong một bài viết gần đây, ông Gates cho rằng các quan ngại xã hội xung quanh AI nên được giải quyết giữa các chính phủ và khu vực tư nhân để đảm bảo nó được sử dụng cho mục đích tốt.

Về các vấn đề kỹ thuật, tỉ phú Mỹ cho biết những tiến bộ gần đây đã không khiến một số vấn đề trở nên “cấp bách hơn so với trước đây”, và các nhà nghiên cứu đã bắt tay vào khắc phục các vấn đề kỹ thuật.

Nguồn: tuoitre.vn