Tại Mỹ, các kỹ sư phát triển thuật toán nhận diện khuôn mặt chủ yếu là người da trắng nên cơ sở dữ liệu chỉ liên quan đến người da trắng và người da đen dễ bị nhận dạng nhầm.

Kết quả nhận dạng khuôn mặt phụ thuộc vào dữ liệu đào tạo thuật toán

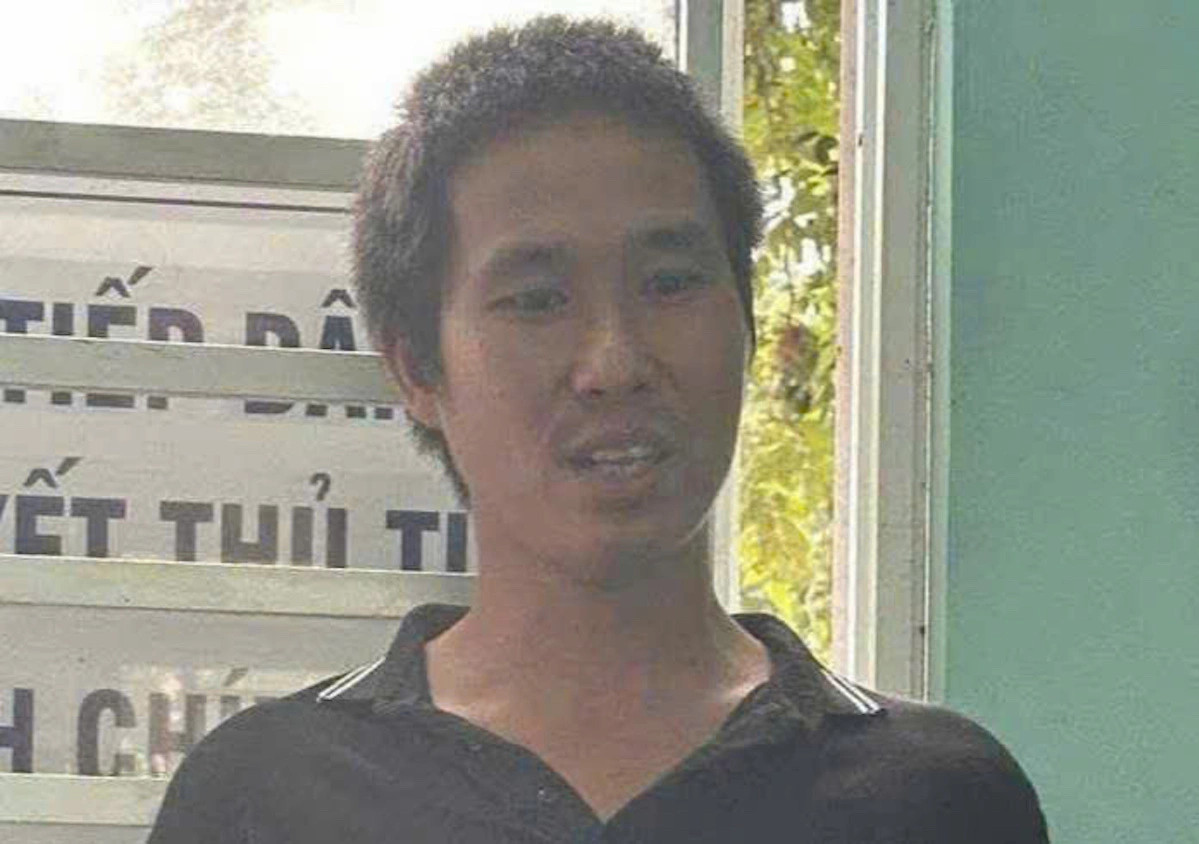

Chị Porcha Woodruff là một ví dụ.

Hôm 3-8, chị Porcha Woodruff (32 tuổi, cư trú ở TP Detroit, bang Michigan) gửi đơn kiện thành phố Detroit và một nữ điều tra viên vì đã bắt và giam giữ chị trái phép, vi phạm tu chính án thứ tư.

Biết công nghệ lỗi vẫn dùng

Theo Hãng tin AFP, sự việc bắt đầu gần nửa năm trước. Tại một trạm xăng xảy ra vụ cướp xe hơi. Hôm 16-2, sáu cảnh sát đến nhà cầm theo lệnh bắt giữ chị Woodruff về tội cướp xe.

Chị ngỡ ngàng: “Trộm xe có súng à? Mấy ông có đùa không? Mấy ông không thấy tôi đang bầu bì tám tháng sao?”.

Cảnh sát đã khám xét và còng tay chị trước mặt gia đình và hàng xóm rồi đưa về thẩm vấn. Chiếc điện thoại iPhone của chị bị thu giữ để tìm chứng cứ. Khoảng 11 tiếng sau chị mới được tại ngoại.

Chị đến bệnh viện khám ngay với kết quả “nhịp tim chậm do mất nước” và “bị co thắt do căng thẳng”. 15 ngày sau, tòa hủy cáo buộc với chị vì không đủ bằng chứng.

Chị Woodruff bị bắt nhầm sau khi Sở Cảnh sát Detroit truy xuất camera tại trạm xăng có ghi lại hình ảnh kẻ tình nghi cướp xe và sử dụng phần mềm nhận diện khuôn mặt DataWorks Plus để đối chiếu.

Kết quả tìm kiếm khớp với cái tên Porcha Woodruff từ giấy tờ tùy thân của chị bị thu giữ năm 2015 khi chị bị bắt do lái xe với bằng lái hết hạn. Thật ra hệ thống nhận dạng khuôn mặt đã nhầm.

Giám đốc Sở Cảnh sát Detroit thừa nhận vấn đề rất nghiêm trọng. Cách đây ba năm, chính vị này đã giải thích nếu chỉ sử dụng duy nhất hệ thống này mà không dùng thêm các phương pháp khác, tỉ lệ sai sót lên đến 96%. Dù vậy năm ngoái cảnh sát Detroit vẫn dùng nó tới 125 lần.

Chị Woodruff là người thứ sáu khẳng định bị cảnh sát Detroit bắt oan do lỗi của hệ thống đó. Tất cả đều là người da đen. Trước đó đã có hai nạn nhân đệ đơn kiện cảnh sát Detroit.

Sau lần nhận dạng sai vào năm 2019, Sở Cảnh sát Detroit đã phải sửa đổi hướng dẫn sử dụng hệ thống nhận dạng khuôn mặt, hạn chế phạm vi sử dụng chỉ trong các vụ điều tra về tội phạm bạo lực hoặc xâm phạm gia cư.

Quan trọng là dữ liệu đào tạo

Trong đơn kiện, các luật sư của chị Woodruff giải thích công nghệ nhận dạng khuôn mặt vốn có nhiều sai sót đã biết nhưng cảnh sát Detroit không đặt ra các quy định phù hợp về sử dụng công nghệ này, và không huấn luyện đầy đủ cho nhân viên cách sử dụng, từ đó cho thấy thái độ thờ ơ cố ý đối với tác hại mà những người bị nhận dạng sai phải gánh chịu.

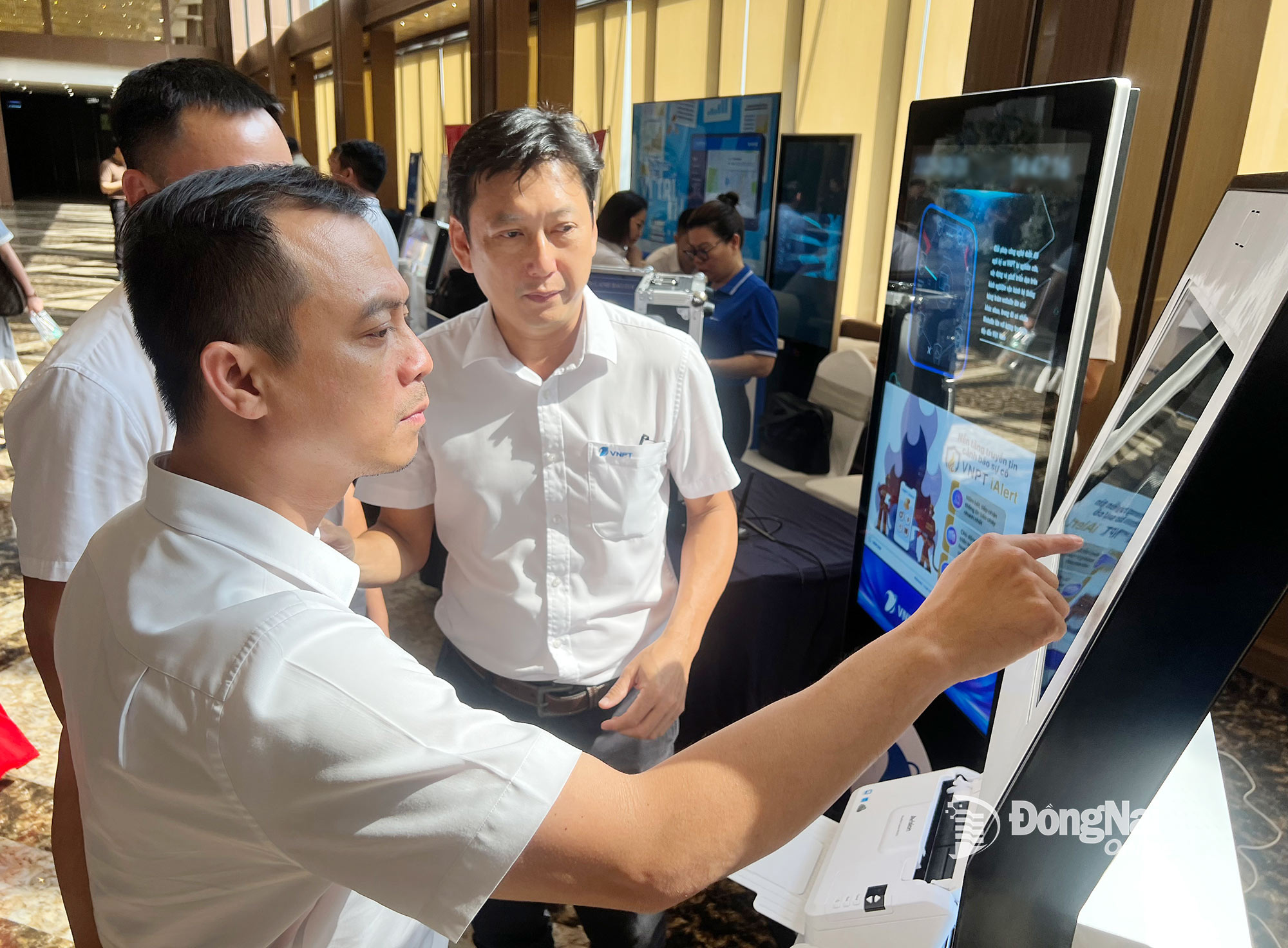

Từ nhiều năm qua, công nghệ nhận dạng khuôn mặt ở Mỹ đã bị phanh phui một số điểm yếu. Muốn nhận dạng khuôn mặt phải cần đến trí tuệ nhân tạo (AI) song công nghệ liên quan đến AI lại còn nhiều sai sót nên độ tin cậy không đạt 100%.

AI hoạt động nhờ học máy mà giai đoạn đầu tiên là đào tạo máy tính, tức dạy cho máy tính thuật toán xử lý dữ liệu đầu vào để có được dữ liệu đầu ra phù hợp. Tuy nhiên tình trạng sai lệch thuật toán có thể xảy ra do dữ liệu không chuẩn.

Báo Washington Post nêu ví dụ vào cuối năm 2019, Viện Tiêu chuẩn và Công nghệ quốc gia (NIST) ở Mỹ đã nghiên cứu hàng chục thuật toán, sau đó kết luận xác suất không nhận dạng được khuôn mặt người da đen hoặc người châu Á cao hơn 100 lần so với khi nhận dạng người da trắng.

Hai thuật toán cũng không xác định đúng giới tính của phụ nữ da đen trong 35% trường hợp. Mức độ khác biệt này thể hiện rõ ràng hơn trong các thuật toán được phát triển ở Mỹ so với các thuật toán được phát triển ở châu Á.

Ngoài ra còn có một số nguyên nhân bị lỗi khác như hình ảnh không chuẩn (độ phân giải xuống cấp, độ sáng không đủ), hoặc khuôn mặt thay đổi (già đi, có trang điểm, đeo kính). Điều này có nghĩa chúng ta có thể đánh lừa hệ thống nhận dạng khuôn mặt hoặc hệ thống có thể nhầm lẫn người này với người kia.

Tạm dừng bán công nghệ nhận diện cho cảnh sát

Tại Mỹ, các tập đoàn lớn như Amazon, Microsoft, IBM và Google đã tạm dừng bán phần mềm nhận dạng khuôn mặt cho cảnh sát.

Theo Trung tâm nghiên cứu Pew, không có dữ liệu tổng thể về số cơ quan thực thi pháp luật sử dụng công nghệ nhận dạng khuôn mặt, nhưng một nhà cung cấp cho biết có đến 3.100 cơ quan thực thi pháp luật ở Mỹ là khách hàng.

Nguồn: tuoitre.vn