Là một trợ lý ảo thông thái, ChatGPT ngày càng được nhiều cá nhân và doanh nghiệp tin dùng, từ chuyện riêng tư đến chiến lược kinh doanh. Và tội phạm mạng bắt đầu tấn công trộm tiền, thu thập dữ liệu từ ChatGPT.

Nhiều rủi ro ngày càng lớn theo mức độ người dùng tận dụng tính năng ChatGPT

Công ty an ninh mạng Group-IB (Singapore) công bố thông tin chưa đầy đủ: hơn 100.000 tài khoản ChatGPT được rao bán trên các “chợ đen”. Việt Nam đứng thứ tư trong danh sách những quốc gia có số tài khoản ChatGPT bị hack nhiều nhất với 4.711.

Nhiều thông tin nhạy cảm của người dùng Việt qua việc sử dụng ChatGPT có thể đã bị lộ.

Mất tiền vì nhờ ChatGPT tạo mật khẩu

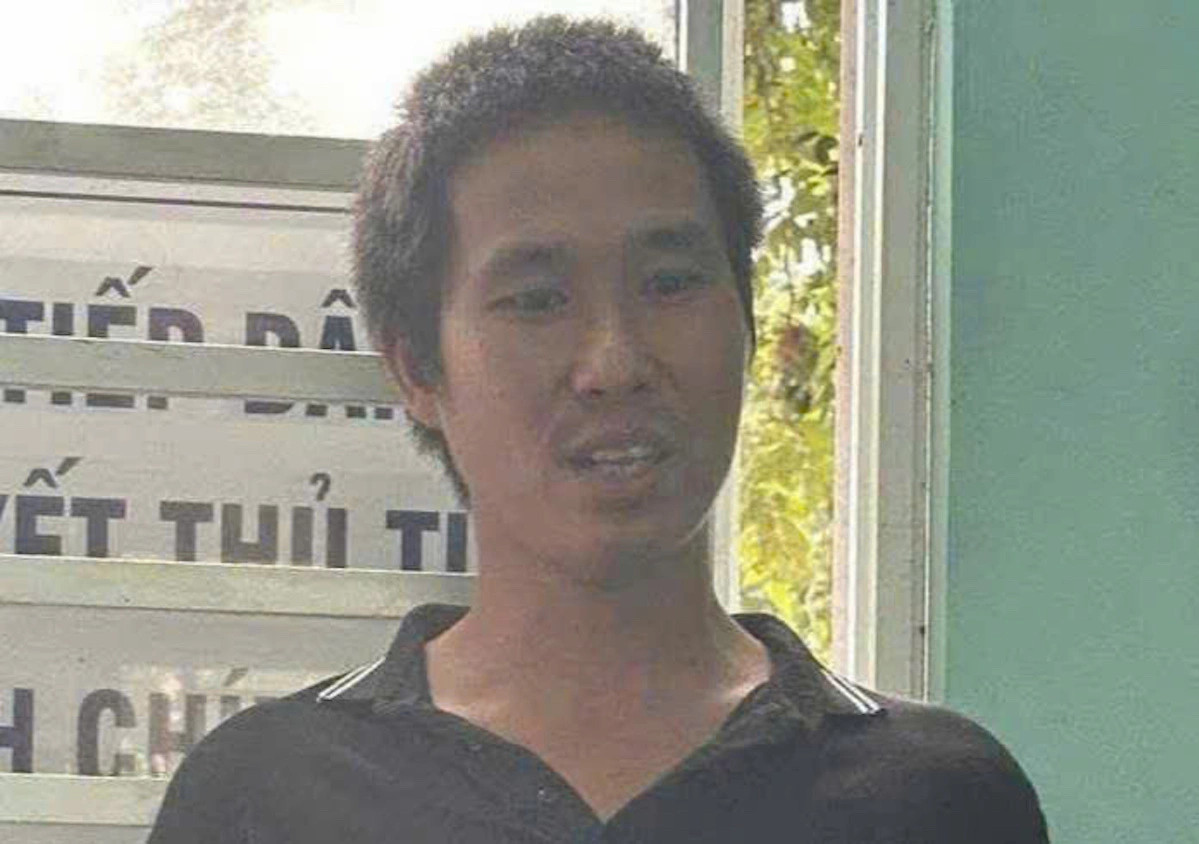

Anh V.N. (quận Tân Phú, TP.HCM) cho biết đã bị mất hơn 50 triệu đồng trong tài khoản ngân hàng cho các hóa đơn thanh toán mua hàng mà anh không hề thực hiện. Tìm hiểu, anh N. phát hiện các tài khoản ngân hàng số, email của mình đều đã bị hacker xâm nhập.

“Tôi đã nhờ ChatGPT tạo lập mật khẩu vừa có độ bảo mật mạnh vừa dễ nhớ. Chủ quan nên chính tôi lại quên mất mật khẩu đó được lưu trữ trong lịch sử chat với ChatGPT nên bị cướp tiền”, anh N. chia sẻ.

May mắn hơn, anh Tấn Thành (quận 7, TP.HCM) cho biết đã phát hiện sớm bất thường nên không bị cướp tài khoản và mất tiền.

“Tôi mua tài khoản ChatGPT từ một người trên mạng và sử dụng thường xuyên. Với sự hữu ích của ChatGPT, tôi thậm chí còn nhờ tạo mật khẩu cho các tài khoản dịch vụ mạng của mình.

Tuy nhiên, nhờ vài lần vô tình đọc lại lịch sử chat với ChatGPT để xem lại tư liệu, tôi phát hiện khá nhiều nội dung chat không phải do mình thực hiện. Điều đó cũng có nghĩa là có người khác cùng sử dụng tài khoản với tôi. Tôi đã ngay lập tức thay đổi toàn bộ mật khẩu”, anh Thành kể.

Nhiều người dùng khác cũng bị rơi vào cảnh một tài khoản ChatGPT nhiều người dùng chung do mua lại từ trên mạng. Tuy nhiên, họ lại không thể nào loại người xâm nhập trái phép kia ra. Sau đó, tài khoản bỗng dưng bị khóa khiến toàn bộ nội dung đã cung cấp lên ChatGPT bị mất.

Điều này khiến không ít người nghi ngờ ChatGPT về mặt riêng tư và bảo mật thông tin.

Hiểm họa tiềm ẩn nếu quá tin

Ông Đặng Hữu Sơn, nhà sáng lập trợ lý ứng dụng viết nội dung bằng AI LovinBot, cho biết một trong những tính năng của ChatGPT được sử dụng khá nhiều là Code interpreter – cho phép người dùng tải lên một tập tin (như excel, pdf…) và yêu cầu ChatGPT phân tích, vẽ biểu đồ.

Sự hữu ích tuyệt vời này đã khiến nhiều người dùng không ngần ngại tải lên các tập tin báo cáo nội bộ.

“Càng sử dụng, người dùng càng muốn ChatGPT phân tích nhiều thứ hơn, như thu nhập vợ chồng, thuế, các thông tin về kế toán… Trong khi đa số tài khoản ChatGPT Plus đều sử dụng thẻ tín dụng nước ngoài, khiến rủi ro tiềm ẩn là rất lớn nếu chẳng may tài khoản ChatGPT bị hack”, ông Sơn cảnh báo.

Đây cũng chính là lý do rất nhiều công ty trên thế giới hiện đã ra quy định cấm tải lên các tài liệu của doanh nghiệp để ChatGPT làm báo cáo, phân tích. Vì các thông tin tài chính, thông tin cá nhân rất có thể sẽ bị công khai…

“Rủi ro ngày càng cao khi thói quen sử dụng ChatGPT ngày càng nhiều. Nó có thể là mật khẩu tài khoản ngân hàng cho đến chiến lược kinh doanh…”, ông Sơn nhận xét.

Bên cạnh đó, do Việt Nam chưa nằm trong các quốc gia được hỗ trợ mở tài khoản bằng thông tin chính chủ nên đa số các tài khoản đều qua trung gian – lỗ hổng lớn về bảo mật. Nhiều người dùng cũng không đăng ký tài khoản chat chính chủ mà sử dụng email, số điện thoại… của người khác để đăng ký.

Các tài khoản này có thể là của hacker, khi có tài khoản hacker có thể xem được lịch sử chat mà người sử dụng tương tác…

Bảo mật của ChatGPT kém?

Theo nhiều chuyên gia bảo mật, ChatGPT có hai loại tài khoản là bản Free và Plus. Cả hai đều có một điểm chung là bảo mật kém.Đầu tiên, ChatGPT không có tính năng giới hạn số lần đăng nhập bằng IP hoặc cảnh báo đăng nhập trái phép nên một tài khoản có thể được dùng để đăng nhập cùng lúc bởi nhiều người.Thứ hai, tính năng xác thực hai lớp hiện cũng không còn hoạt động khiến chỉ phụ thuộc vào mật khẩu.

Làm gì để giảm rủi ro?

Ông Vũ Thanh Thắng, Công ty An ninh mạng thông minh SCS, cho biết có hai hình thức tấn công phổ biến vào ChatGPT: thứ nhất, hacker lấy được thông tin tài khoản của ChatGPT và có thể đọc được thông tin lịch sử chat; thứ hai là sử dụng mã độc để cài được key logger (ghi lại thao tác bàn phím) vào máy nạn nhân.

“Với hình thức thứ hai, hacker có thể biết được toàn bộ thông tin của người sử dụng máy tính khi họ nhập liệu vào máy. Khi đó, hacker nắm toàn bộ quyền điều khiển máy tính của nạn nhân và tất cả các thông tin cá nhân khác… Nạn nhân có thể mất rất nhiều, kể cả tài khoản ngân hàng”, ông Thắng nói.

Từ đó, ông Thắng khuyến cáo người sử dụng không nên truy cập vào các đường dẫn lạ, không rõ nguồn gốc hoặc các tập tin đính kèm được gửi từ các email nếu không biết rõ người gửi… để tránh lây nhiễm các mã độc do hacker tạo ra.

Để hạn chế các lừa đảo từ việc khai thác log chat (bản ghi lịch sử chat) từ các công cụ AI, người dùng nên loại bỏ cơ chế lưu lại lịch sử chat hoặc phải thường xuyên vào xóa lịch sử chat với công cụ này”, ông Thắng cho biết.

Ông Đặng Hữu Sơn cũng khuyến nghị người dùng: “Tuyệt đối không nên sử dụng chung tài khoản, dù là người quen, bạn bè. Người dùng nên đổi mật khẩu mỗi tháng/lần hoặc ngay khi thấy dấu hiệu bất thường. Không nên tải lên các tập tin quan trọng vì rủi ro rất lớn nếu bị chiếm đoạt”.

Hứa nâng cấp ChatGPT Plus để lấy thông tin thẻ tín dụng

Hiện Open AI chưa hỗ trợ mua dịch vụ Plus trên ChatGPT bằng thẻ Việt Nam nên hầu hết người có tài khoản ChatGPT Plus đều phải sử dụng thẻ ảo quốc tế, mượn thẻ từ người thân ở nước ngoài.

Lợi dụng điều này, kẻ xấu hứa hẹn sẽ nâng cấp được bằng thẻ tín dụng chính chủ (do ngân hàng Việt Nam phát hành). Theo các chuyên gia bảo mật, chúng sẽ đưa ra những trường hợp nâng cấp thành công, mà thực chất là giả mạo, để yêu cầu chủ thẻ chụp thông tin thẻ. Nếu cung cấp, nạn nhân sẽ dễ dàng bị mất tiền trong tài khoản.

Nguồn: tuoitre.vn